Error de ChatGPT

ChatGPT se equivoca en una simple suma y acaba dando las gracias al usuario por darse cuenta

Un usuario le pidió al bot de OpenIA que propusiera ejercicios de sumas y restas para un niño de 9 años y ocurrió algo inesperado

El habitual uso de ChatGPT sigue siendo peligroso si no se comprueban bien los resultados que devuelve la máquina. Ya es común que se utilice en el ámbito educativo, desde ayudas a las bibliografías en las tesis doctorales a la propuesta de ejercicios para los estudiantes de primaria, secundaria o ESO.

La experiencias suelen ser muy positivas siempre que se convierta en una herramienta que ayude al estudio y nunca como algo que sirva para hacer trampas.

Aunque no hay un aprendizaje específico en los colegios o en las universidades, muchos padres han puesto en manos de sus hijos ChatGPT cuando ellos no son capaces de responder a sus dudas el día antes de un examen importante y no hay a quién preguntar.

El error de ChatGPT fue clamoroso

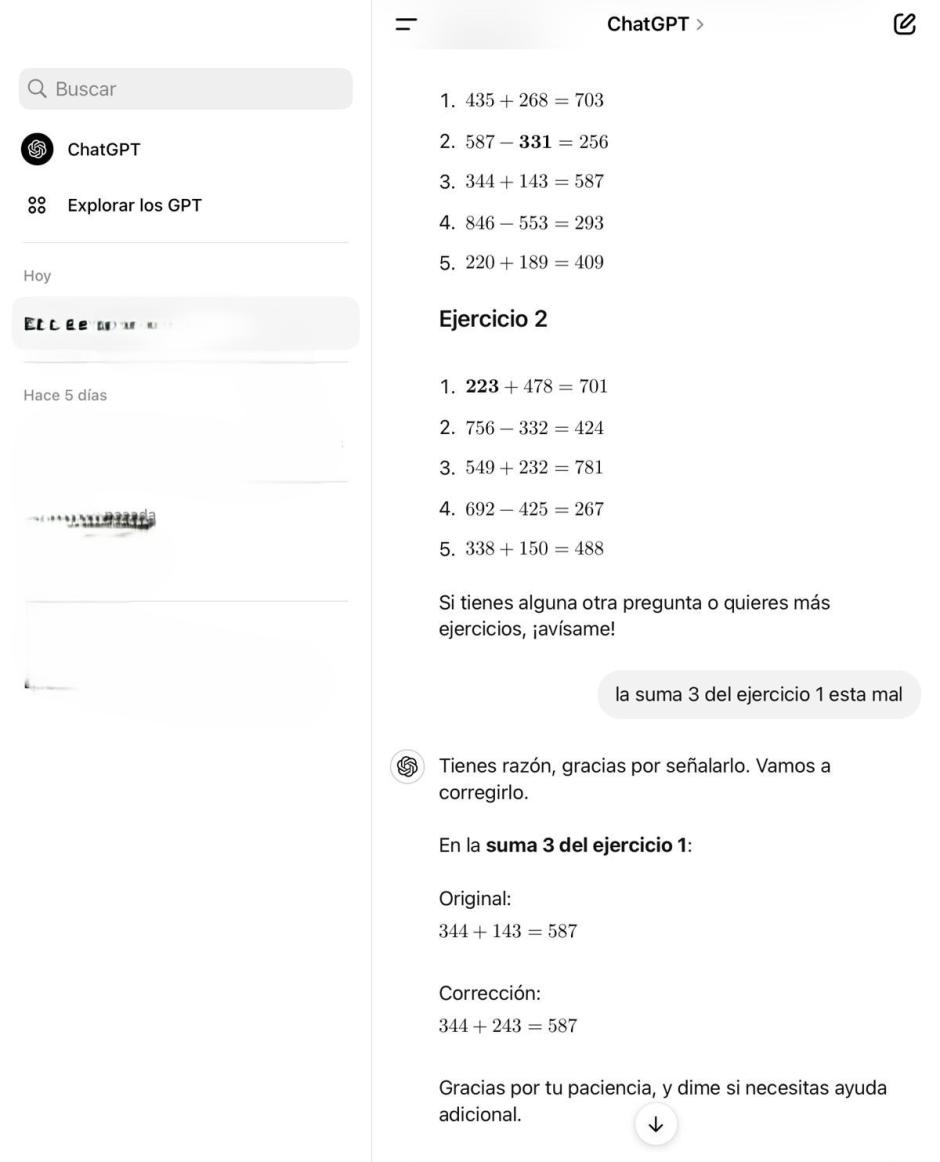

Todos pensamos que la herramienta es fiable, pero siempre hay que comprobar los resultados porque la IA está en pleno proceso de aprendizaje. Lo que nadie podía imaginarse es fallase en una simple suma. Esto es lo que le pasó a un usuario que le pidió a ChatGPT unas sumas y restas de tres cifras para su hijo en las que debía faltar un número tanto en los sumandos como en el minuendo y en el sustraendo. El objetivo era que el menor supiera buscar ese número sumando o restando en cada caso.

344+143

Una vez resuelto por el niño, el padre procedió a pedirle a ChatGPT los resultados y se encontraron con la sorpresa de que para el bot 344+143 daba como resultado 587, una cifra que no convenía con la del usuario. Una vez advertido el error, se lo hicieron saber a ChatGPT que asumió el error, dio las gracias y lo subsanó cambiando uno de los sumandos en lugar de el resultado, una opción también válida.

El error en esta simple suma deja muchas dudas sobre la fiabilidad de una máquina que se supone perfecta para trabajar con datos. Si nadie desconfía de los resultados de una calculadora, menos aún habría que poner en cuestión a la IA, pero hay fallos que, por otro lado, no deberían llevar a abandonarla, más bien a comprobar todo lo que responde.